Trắng, đen và công nghệ

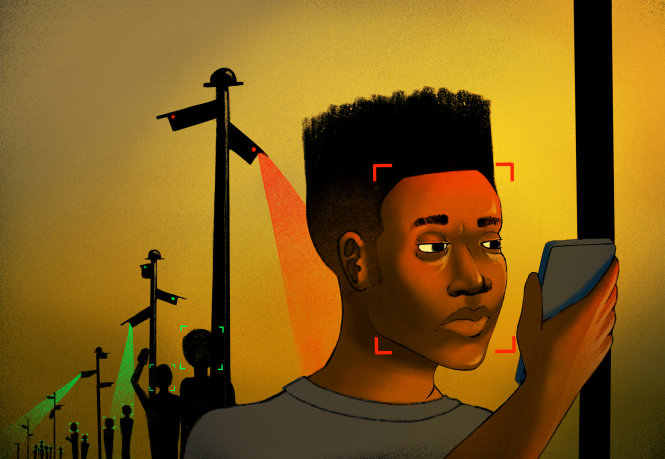

TTCT - Khi phong trào Black Lives Matter đòi quyền được đối xử công bằng cho người da màu và phản đối bạo lực cảnh sát bùng phát ở Mỹ rồi lan sang nhiều nước, những tranh cãi xoay quanh công nghệ nhận dạng khuôn mặt dường như nóng trở lại.

|

| Ảnh: truthout.org |

Các phần mềm nhận dạng khuôn mặt nói chung, cũng như các ứng dụng khác của trí tuệ nhân tạo (AI), có một lịch sử dài bị cáo buộc mang thiên kiến chủng tộc. Lĩnh vực nghiên cứu trí tuệ nhân tạo cũng thường bị chỉ trích là thiếu sự đa dạng khi đàn ông da trắng chiếm phần lớn, theo báo The Guardian.

Amazon “đạo đức giả”?

Amazon từng đăng đàn trên mạng xã hội Twitter kêu gọi chấm dứt “sự đối xử bất công và tàn bạo đối với người da đen” tại Mỹ và đổi ảnh banner trên trang chủ thành khẩu hiệu ủng hộ phong trào Black Lives Matter. Song công ty này lập tức bị gọi là “đạo đức giả” khi tiếp tục bán phần mềm nhận dạng khuôn mặt cho các lực lượng cảnh sát.

Trước sức ép ngày càng mạnh mẽ, đầu tháng 6-2020, Amazon tuyên bố đang tạm dừng một năm việc hợp tác cung cấp phần mềm nhận dạng khuôn mặt Rekognition do hãng phát triển cho cảnh sát Mỹ. Amazon không cung cấp chi tiết số lượng lực lượng cảnh sát hiện đang sử dụng phần mềm của hãng hoặc sử dụng cho mục đích gì.

Ngay thời điểm ra mắt vào tháng 11-2016, phần mềm Rekognition đã bị các nhóm nhân quyền chỉ trích là một hệ thống giám sát đầy quyền lực cung cấp công cụ để nhắm vào các cộng đồng người da màu. “Nhận dạng khuôn mặt là một công cụ khủng khiếp và thiếu chính xác, giúp thúc đẩy phân biệt chủng tộc và giám sát hàng loạt” - hạ nghị sĩ gốc Mỹ Latin Alexandria Ocasio-Cortez viết trên Twitter ngày 10-6.

Một thử nghiệm do Liên đoàn tự do dân sự Mỹ (ACLU) tiến hành năm 2018 cho thấy phần mềm Rekognition đã “nhận dạng” lầm 28 thành viên Quốc hội Mỹ là tội phạm có tiền án tiền sự, trong đó phần lớn là các chính khách da màu.

Trong tuyên bố ngày 10-6, Amazon cho biết sẽ tạm thu hồi quyền sử dụng phần mềm Rekognition trong các lực lượng cảnh sát cho đến khi có quy định chặt chẽ hơn về việc sử dụng công nghệ nhận dạng khuôn mặt trong lĩnh vực này. Quyết định được công bố không lâu sau khi hãng công nghệ IBM cũng tuyên bố chấm dứt vĩnh viễn việc nghiên cứu phát triển công nghệ nhận dạng khuôn mặt của hãng.

Dù có số ít người cho rằng hành động này thể hiện một bước đi đúng hướng, phần đông nhận xét đây không gì khác hơn là một chiêu trò PR của Amazon, đồng thời cáo buộc công ty có thể sẽ dành năm đó để cải tiến công nghệ và vận động hành lang để thúc đẩy Quốc hội ban hành các quy định có lợi cho việc tái giới thiệu công nghệ nhận diện khuôn mặt trong tương lai.

Giám đốc ACLU Nicole Ozer kêu gọi Amazon có những cam kết có ý nghĩa hơn và cho rằng “mối đe dọa của công nghệ giám sát này đối với quyền công dân và quyền tự do dân sự sẽ không biến mất trong một năm”. Theo Nicole, Amazon phải hoàn toàn cam kết thực hiện việc cấm sử dụng nhận dạng khuôn mặt cho đến khi các mối nguy hiểm có thể được giải quyết thỏa đáng.

|

| Ảnh: Getty Images |

Gương mặt và màu da

Động thái của IBM, Amazon hay mới nhất là Microsoft xới lại câu chuyện về những rủi ro cố hữu của AI, đặc biệt trong phương diện thiên kiến và xâm phạm quyền riêng tư.

“Mạng lưới thần kinh của công nghệ nhận diện bằng AI được đào tạo tốt và có khả năng nhận dạng đáng kinh ngạc, nhưng chỉ một tham số nhỏ bị sai lệch cũng có thể dẫn đến kết quả nhận dạng sai” - nhà nghiên cứu AI Ken Bodnar giải thích với tạp chí Forbes.

Theo ông Ken, trong lĩnh vực AI thì tất cả mọi thứ đều là một bài toán xác suất. Khi nhìn vào một khuôn mặt, công nghệ tính toán dựa theo một loạt các thuật toán và chỉ số khác nhau. Một trong những công cụ chính xác nhất hiện nay là mạng niềm tin sâu (deep belief network) hoạt động theo nguyên lý đánh giá từng chi tiết riêng lẻ trên khuôn mặt như cằm, khoảng cách giữa 2 mắt, kiểu tóc, chân mày, và môi, nhưng bản chất của mạng này vẫn là rất dễ bị đánh lừa.

Trong một số ứng dụng của nhận dạng khuôn mặt, ví dụ như trong các app chỉnh ảnh hay tạo “filter” lung linh cho cuộc gọi video, tính chính xác tuyệt đối không phải là vấn đề quá lớn. Nhưng nếu công nghệ này được sử dụng để giúp cảnh sát quyết định việc bắt hay không bắt một người thì đó lại là một câu chuyện khác.

Một nghiên cứu của MIT năm 2019 đã phát hiện rằng tất cả các công cụ nhận dạng khuôn mặt phổ biến đều gặp vấn đề lớn khi nhận dạng người da màu. Một nghiên cứu khác của Viện tiêu chuẩn và công nghệ quốc gia Hoa Kỳ cho thấy phần mềm nhận dạng khuôn mặt gặp nhiều lỗi hơn trong nỗ lực nhận diện người da đen và châu Á so với người da trắng.

Điều này có nghĩa là những người da màu có nhiều khả năng bị nhận dạng không chính xác hơn, và do đó trở thành mục tiêu bị cảnh sát nhắm đến một cách không công bằng. Đây hoàn toàn có thể là một kết quả không mong muốn, nhưng hệ quả mà nó mang lại là một thiên kiến chủng tộc nguy hiểm và trái đạo đức.

Theo nhiều chuyên gia, cuộc tranh luận về nhận dạng khuôn mặt chắc chắn còn diễn biến phức tạp và thậm chí có thể dẫn đến những kết quả ngoài dự kiến. Kjell Carlsson, chuyên viên phân tích tại công ty nghiên cứu thị trường Forrester, cho rằng các động thái bài xích nhận dạng khuôn mặt phản ánh sự thiếu hiểu biết của số đông người dân về công nghệ này.

Công chúng đang đánh đồng nhận dạng khuôn mặt với nhận dạng và theo dõi cơ thể, phân tích khuôn mặt, phát hiện khuôn mặt, nhận dạng giới tính/tuổi/dân tộc, xác nhận sinh trắc học... cũng như hiểu sai về sự khác biệt giữa một trường hợp sử dụng cụ thể và công nghệ nhận dạng khuôn mặt nói chung.

Theo Kjell, sự không rõ ràng trong cam kết thắt chặt quản lý công nghệ nhận dạng khuôn mặt của các hãng công nghệ dường như mang lại tác hại kép: chính sách không hiệu quả trong ngăn chặn việc lạm dụng nhận dạng khuôn mặt trong khi lại gây cản trở các trường hợp sử dụng cho mục đích chính đáng.

Theo ông, nhận dạng khuôn mặt có nhiều ứng dụng tích cực như giúp xác định nạn nhân trong các vụ bắt cóc, giúp chẩn đoán các rối loạn di truyền hiếm gặp ở trẻ em nhờ phân tích khuôn mặt ứng với kiểu hình di truyền, hoặc để giảm thiểu dương tính giả trong các kỹ thuật mà cảnh sát đã sử dụng để đối chiếu khuôn mặt kẻ tình nghi với dữ liệu tội phạm trong nhiều thập kỷ.

Bất chấp các động thái pháp lý và xã hội liên quan đến nhận dạng khuôn mặt, một thực tế không thể chối bỏ là công nghệ nhận dạng này sẽ tiếp tục chứng kiến sự đổi mới và phát triển mạnh mẽ trong hiện tại và tương lai.

Trên kho lưu trữ mã nguồn lớn nhất thế giới GitHub, nhiều hệ thống nhận dạng khuôn mặt phức tạp được người dùng tải lên và chia sẻ miễn phí cho thấy một dòng chảy ngầm của công nghệ này bên cạnh các sản phẩm do công ty lớn phát triển.

“Tôi hi vọng rằng [IBM, Microsoft hay Amazon] sẽ quay lại với một hệ thống được thiết kế tốt hơn, tôn trọng quyền riêng tư của người dùng và cho phép sử dụng trong những lúc cần thiết với ý thức bảo vệ người dùng và dữ liệu của họ” - bà Lovelesh Chhabra, phó chủ tịch Verizon Media, nói với Forbes.

“Tin vui là phát triển một công nghệ nhận dạng phi-thiên-kiến là hoàn toàn khả thi, với điều kiện mọi khâu liên quan, từ ứng dụng, phần cứng đến nhà cung cấp hệ điều hành, cần phải sẵn sàng cam kết cho mục tiêu đó” - André Ferraz, nhà sáng lập và CEO của Incognia, tỏ ra lạc quan.■

Theo thông báo của Amazon, phần mềm Rekognition vẫn tiếp tục được sử dụng trong các cuộc điều tra liên quan đến buôn lậu người do Trung tâm quốc tế về trẻ em mất tích và bị bóc lột (ICMEC) tiến hành. Hãng cũng không đả động đến Ring, công ty cung cấp chuông cửa thông minh tích hợp camera an ninh từng bị chỉ trích là góp phần gia tăng kỳ thị người da màu. Một điều tra của tạp chí Motherboard năm 2019 cho thấy người da màu có xu hướng là nạn nhân nhiều hơn của ứng dụng Neighbors, nơi người dùng Ring đăng tải video và hình ảnh của những người lạ “đáng nghi” mà camera của họ ghi nhận được để cảnh báo cho cảnh sát và những người dùng trong cùng khu vực. Ứng dụng hiện đang là đối tác của hơn 1.300 sở cảnh sát trên khắp nước Mỹ - tăng hơn 300% so với tháng 8-2019. |

Tài liệu được công bố rộng rãi mới đây theo đạo luật tự do thông tin của Úc dường như cho thấy cảnh sát bang Victoria có sử dụng phần mềm nhận dạng khuôn mặt do Công ty Clearview AI cung cấp. Trong email trao đổi với một sĩ quan, dịch vụ này tự nhận là “Google cho những khuôn mặt” với khả năng đối chứng bất kỳ khuôn mặt nào do cảnh sát cung cấp với kho dữ liệu hơn 3 tỉ khuôn mặt đã được định danh. Để có được khối lượng dữ liệu khổng lồ đó, công ty đã sử dụng phương pháp gây tranh cãi là quét toàn bộ hồ sơ cá nhân của người dùng trên Facebook và các mạng xã hội phổ biến khác. Người phát ngôn Sở cảnh sát bang Victoria khẳng định lực lượng này đã ngừng sử dụng phần mềm trên sau một thời gian thử nghiệm bằng các hình ảnh minh họa có sẵn trên mạng, và chưa ứng dụng công nghệ này vào bất kỳ cuộc điều tra thực tế nào. |

Không có nhận xét nào:

Đăng nhận xét